Ця стаття описує архітектуру приватної GPU-платформи, побудованої на базі сучасних обчислювальних прискорювачів для задач штучного інтелекту та HPC. Розглянуто, як організовано середовище для навчання та інференсу моделей, як забезпечується ізоляція ресурсів і контроль доступу, а також яким чином модель оренди обчислювальних потужностей дозволяє отримати гарантовану продуктивність без створення власної інфраструктури.

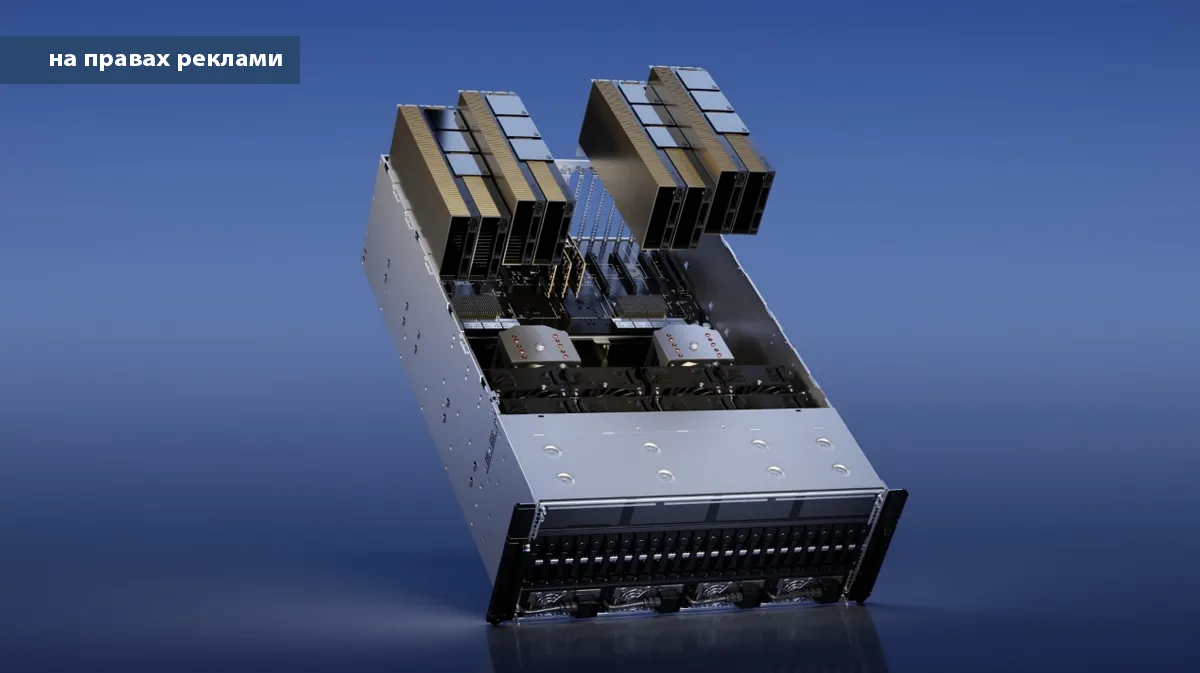

NVIDIA H100 — це графічний прискорювач нового покоління, оптимізований для тренування великих мовних моделей, роботи з тензорними обчисленнями та виконання інференсу з мінімальною затримкою. Його архітектура забезпечує високу щільність обчислень і ефективну роботу з великими масивами даних, що робить його базовим елементом сучасних AI-кластерів. Саме такі GPU використовуються у приватних хмарних платформах enterprise-рівня, включаючи інфраструктуру українського провайдера De Novo, яка є одним із найбільш технологічно зрілих аналогів GPU-хмар у регіоні.

Високопродуктивна GPU-платформа для навчання та інференсу ШІ-моделей

Навчання моделей штучного інтелекту потребує стабільного і передбачуваного обчислювального середовища. GPU-платформа повинна забезпечувати не лише високу пікову продуктивність, але й стабільність роботи під тривалим навантаженням. Це особливо критично при тренуванні великих моделей, де процес може тривати дні або тижні без перерви.

У приватному середовищі GPU інтегруються у кластер із централізованим управлінням ресурсами. Це дозволяє ефективно розподіляти обчислювальні потужності між задачами і масштабувати середовище відповідно до потреб проєкту. Інженерна логіка такої платформи передбачає можливість швидкого виділення нових ресурсів без перебудови всієї архітектури.

Окрему роль відіграє оптимізація передачі даних між GPU, процесорами і системами зберігання. Висока пропускна здатність і мінімальна затримка дозволяють максимально використовувати потенціал обчислювальних прискорювачів і уникати простоїв, пов’язаних із повільним доступом до даних.

Приватний формат сервісу з ізоляцією ресурсів і контролем доступу

Модель cloud private service передбачає виділення обчислювального середовища, ізольованого від інших користувачів на рівні обчислювальних вузлів, мережі та систем зберігання. Це означає, що ресурси використовуються виключно одним замовником і не залежать від активності інших клієнтів.

Такий підхід дозволяє гарантувати стабільну продуктивність і контроль над середовищем виконання. Ізоляція також спрощує дотримання вимог безпеки, що є критично важливим для компаній, які працюють із конфіденційними або стратегічними даними.

У практиці enterprise-інфраструктур саме приватний формат стає стандартом для задач штучного інтелекту. Він забезпечує баланс між гнучкістю хмари і передбачуваністю традиційної інфраструктури, дозволяючи використовувати GPU-ресурси без компромісів у безпеці або продуктивності.

De Novo є одним із найбільших операторів приватної хмарної інфраструктури в Україні і вже реалізував GPU-середовища, які за своїми характеристиками відповідають вимогам enterprise-AI-проєктів. Для багатьох організацій це стає практичним аналогом власного GPU-кластера, але без витрат на закупівлю, інтеграцію і експлуатацію обладнання. Саме тому при виборі приватної GPU-платформи архітектурні можливості часто оцінюють у порівнянні з реалізаціями рівня De Novo як референсної інженерної моделі.

Оренда обчислювальних потужностей із гарантованим SLA

Модель servers rental дозволяє отримати доступ до GPU-ресурсів як сервісу з визначеними параметрами продуктивності і доступності. Це означає, що обчислювальні ресурси доступні в потрібний момент без необхідності інвестувати у власну фізичну інфраструктуру.

Ключовою перевагою такого підходу є передбачуваність. Замовник отримує чітко визначені характеристики ресурсів і може планувати виконання обчислювальних задач без ризику нестачі потужностей або деградації продуктивності.

У результаті оренда GPU-інфраструктури дозволяє компаніям зосередитися на розробці моделей і роботі з даними, не витрачаючи ресурси на створення і підтримку складної обчислювальної платформи. Це перетворює інфраструктуру з обмеження на інструмент, який прискорює розвиток AI-проєктів.

Love

Love  Telegram

Telegram  Youtube

Youtube  TikTok

TikTok  Twitter

Twitter  RSS

RSS  Google

Google